| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 |

Tags

- C++

- AWS

- idToken

- @Transactional

- Expo

- Spring

- OG tag

- google 로그인

- JPA

- react native

- YOLOv5

- google login

- javascript

- Loss Function

- Spring Boot

- pandas

- oauth

- 2021 제9회 문화공공데이터 활용경진대회

- html

- skt fellowship 3기

- 졸프

- yolo

- google cloud

- 양방향 매핑

- 코드업

- 커스텀 데이터 학습

- marksense.ai

- STT

- 순환참조

- matplotlib

Archives

- Today

- Total

민팽로그

Recurrent Neural Network(RNN) 본문

RNN

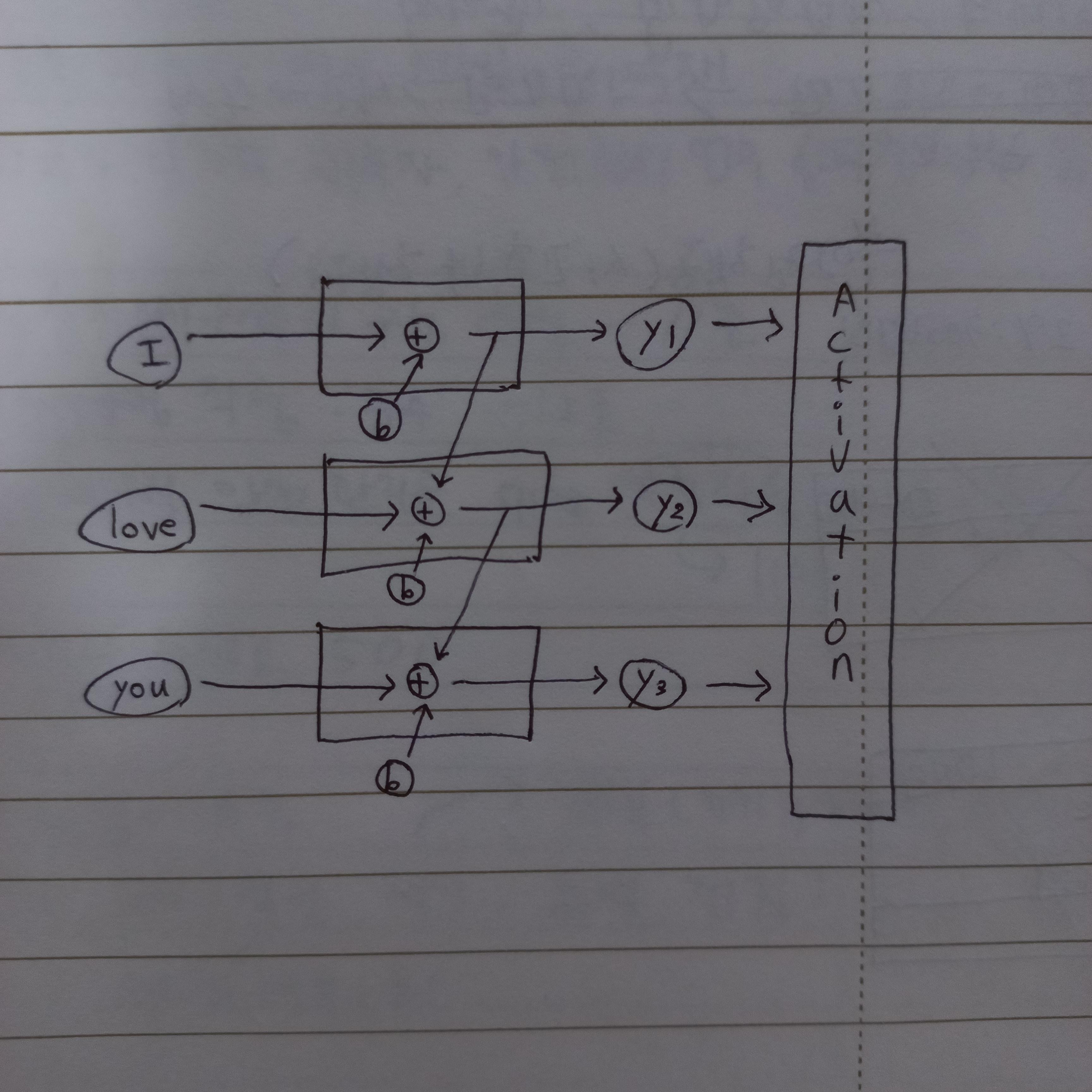

현재 input 값이 바로 직전 input에 대한 output 값에 영향을 받는 구조.

$$ h_{t}=wx_{t}+b+h(x_{t-1}) $$

rnn은 전 단계의 입력을 다음 단계가 기억할 수 있다는 특징이 있지만 정규화 과정을 통해 input값이 줄어 전달되기 때문에 input의 수가 많아질수록 성능이 떨어진다는 한계가 있음

LSTM(Long Short Term Memory)

RNN의 한계를 극복하기 위해 이전 입력에 대한 정보 뿐만 아니라 이전 입력의 이전 입력에 대한 정보까지 저장할 수 있음

$$ h_{t}=wx_{t}+b+h(x_{t-1})+h(x_{t-2}) $$

forget gate를 두어 특정 입력에 대해서는 현재 입력과 이전 입력에 대한 정보 까지만 기억하게 하는 부분도 있음.

즉, t-2 시점에 대한 정보의 영향력 감소

'머신러닝&딥러닝' 카테고리의 다른 글

| 9월 29일 언어 지능 실습 (0) | 2021.09.29 |

|---|---|

| 9월 28일 언어 지능 실습 정리 (0) | 2021.09.28 |

| 활성화 함수(Activation Function) (0) | 2021.09.28 |

| 선형 회귀(Linear Regression) (0) | 2021.09.27 |

| [용어 정리]object detection 공부하면서 모르는 용어 (0) | 2021.08.31 |

Comments